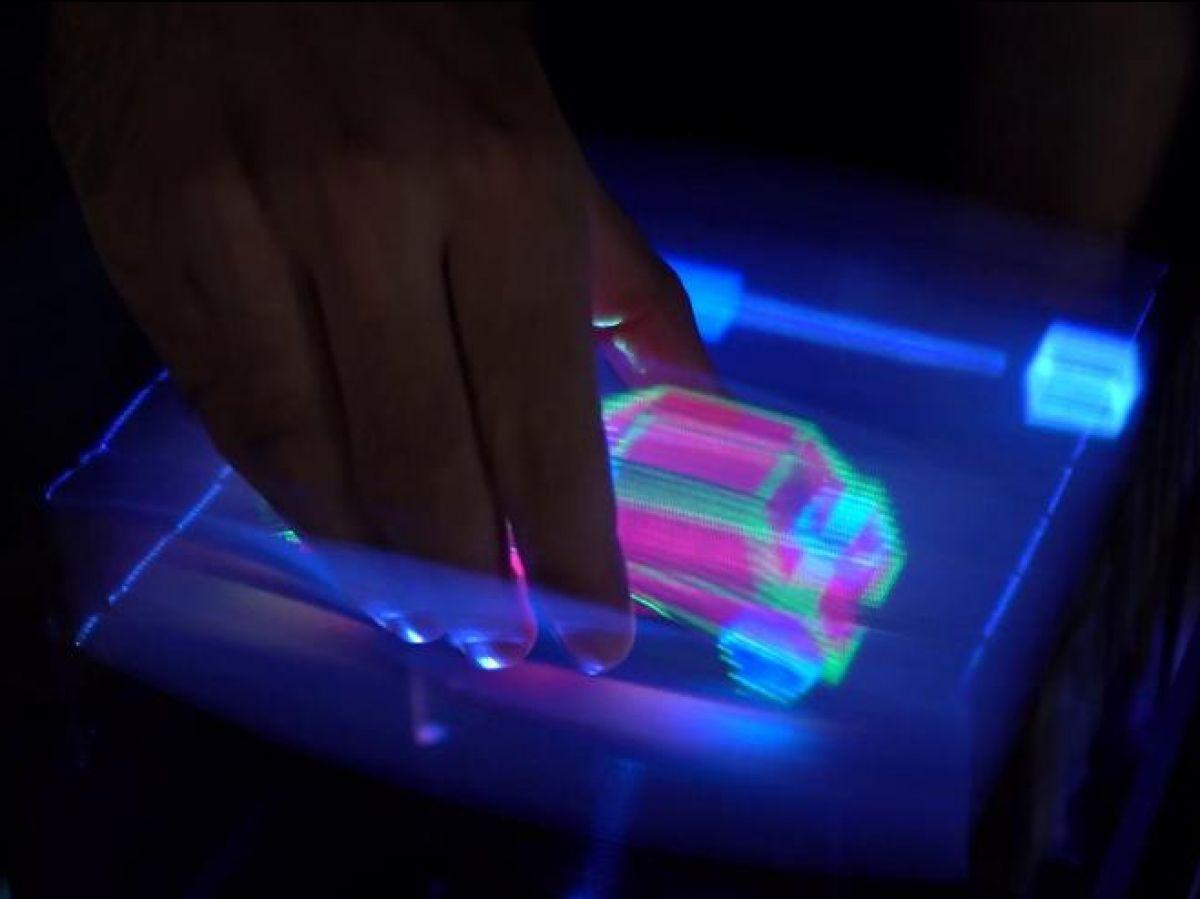

Africa-Press – Guinee Equatoriale. Il y a quelques années, la société australienne Voxon Photonics dévoilait un système d’affichage volumétrique et interactif, permettant à un utilisateur de naviguer dans des dossiers et des fichiers en 3D, de manipuler des objets aux allures d’hologrammes et de les regarder sous tous les angles. Ces actions dans l’espace nécessitent néanmoins l’usage d’un contrôleur, une souris 3D placée à proximité de l’écran.

En revanche, une équipe de l’université de Navarre (Espagne) va présenter à la prochaine conférence sur les interactions homme-machine (CHI 2025), fin avril 2025 à Yokohama, un projet dans lequel l’utilisateur intervient sur des objets virtuels en volume et dans l’espace directement avec les doigts et les mains.

Décrit dans un article en accès libre, l’appareil est appelé FlexiVol. « Vol » pour l’affichage volumétrique et « Flexi » pour l’écran en matériau flexible. C’est justement là que se situe la principale astuce technologique: les contenus en 3D s’affichent par le biais d’un projecteur sur un écran constitué en réalité de bandes élastiques parallèles de 2 cm de large en élastane, silicone et polyester (le même matériau utilisé pour les écrans de projection classique).

Un assemblage de bandes élastiques monté sur ressorts

Cet assemblage souple est monté sur ressorts et soumis à un mouvement oscillatoire de forme sinusoïdale ultra-rapide: 2880 hertz. Cette fréquence est synchronisée avec les projections. Autrement dit, 2880 images par seconde s’affichent sur un écran qui bouge dans le sens de la profondeur. La persistance rétinienne chez l’utilisateur crée l’illusion d’un volume, comme, au cinéma, le défilement de 24 images fixes par seconde crée celle du mouvement.

Le principe d’une membrane souple en plusieurs morceaux donne la possibilité de littéralement traverser l’écran avec la main pour saisir virtuellement un objet modélisé en 3D. En fait, c’est comme s’il n’y avait pas vraiment de support empêchant d’ »attraper » les projections. Il y en a évidemment un mais il ne fait pas obstacle au geste.

Deux caméras stéréoscopiques combinées à des logiciels open source de Google (Mediapipe) composent le système de suivi des mouvements des doigts et de la main. En fonction de quoi, la position, le déplacement et l’apparence des objets virtuels sont recalculés en temps réel, et l’utilisateur peut ainsi saisir, déplacer, faire glisser ou pivoter ce qui est projeté, selon les mêmes gestes qu’il aurait avec des objets réels.

18 participants ont testé le dispositif

L’équipe a fait tester le dispositif à 18 participants en leur assignant diverses manipulations au travers de ce dispositif et, en guise de comparaison, avec un appareil à souris 3D. La grande majorité considère plus intuitive et naturelle l’interaction directe avec les mains. L’inconvénient principal se situe au niveau de la précision du geste, qui se pose aussi avec les écrans tactiles, comparé à une souris et d’un pointeur. Une certaine fatigue physique, à long terme, peut être ressentie, à force d’avoir les mains dans le vide et les bras en tension. L’équipe pense pouvoir y remédier en modifiant le design l’appareil pour le rendre plus ergonomique.

Pour plus d’informations et d’analyses sur la Guinee Equatoriale, suivez Africa-Press