Africa-Press – Benin. Les implants cérébraux pour décoder la parole ne cessent de faire des progrès ! Ces dispositifs « lisent » le cerveau et « comprennent » ce que la personne veut dire, permettant à des personnes paralysées ou ayant perdu la parole de communiquer. Mais non seulement ils décodent ce que l’utilisateur veut dire, mais ils peuvent même désormais identifier la langue dans laquelle il veut le dire !

Ce premier dispositif « bilingue », conçu par des chercheurs de l’Université de Californie à San Francisco et à Berkeley (Etats-Unis), a permis à un homme ayant perdu la parole à cause d’un AVC de communiquer à nouveau dans les deux langues qu’il parlait avant, anglais et espagnol, grâce à une intelligence artificielle (IA) qui reconnait la langue qu’il veut utiliser. Les résultats de ce premier test ont été publiés le 20 mai 2024 dans la revue Nature Biomedical Engineering.

L’implant est associé à une IA qui prédit ce que la personne veut dire

Pancho avait 20 ans lorsqu’un AVC a bousculé sa vie, paralysant la majorité de son corps. Depuis, cet homme d’origine latino-américaine ne parvient plus à parler clairement, souffrant d’une condition nommée anarthrie (qui empêche de contrôler les muscles liés à la parole).

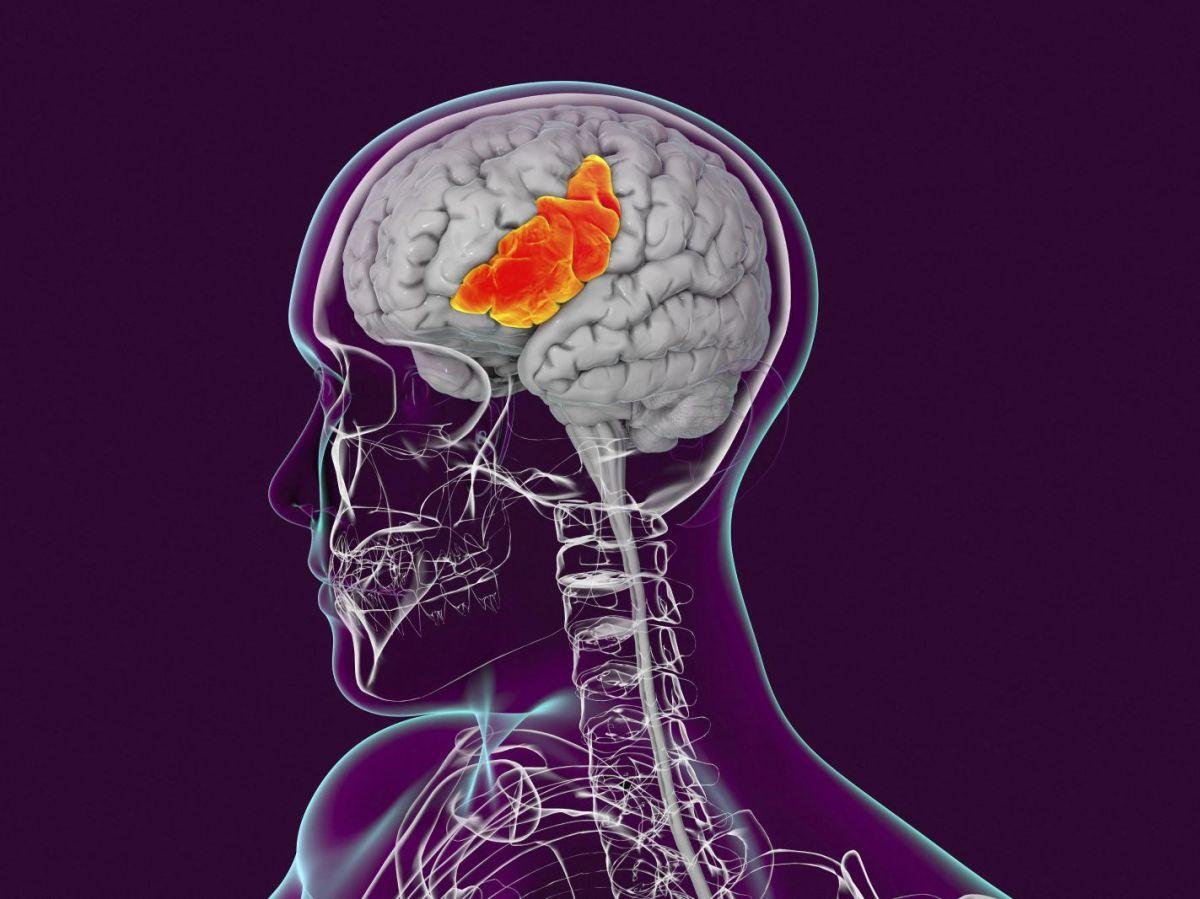

A ses 36 ans, pour l’aider à communiquer à nouveau, les chercheurs lui ont greffé un implant cérébral qui, avec 128 électrodes, lit l’activité du cortex gérant la parole et décode les mots qu’il veut prononcer (ces travaux ont fait l’objet d’une étude publiée en 2021 dans le New England Journal of Medicine). Cet implant est associé à une intelligence artificielle qui non seulement décode le mot, mais prédit les mots les plus probables qui vont suivre (comme ChatGPT qui évalue le mot le plus probable qui devrait suivre ceux déjà écrits). Ainsi, le logiciel qui accompagne l’implant peut proposer des phrases entières à Pancho pour lui permettre de s’exprimer plus rapidement que si tous les mots étaient décodés un par un.

Une IA qui devine la langue dans laquelle il veut parler

Mais cette IA était entrainée pour reconnaître des mots en anglais, alors que la langue maternelle de Pancho est l’espagnol et même s’il parlait anglais, c’est principalement en espagnol qu’il s’exprimait. Pour résoudre ce problème, les chercheurs ont modifié le système pour qu’il puisse prédire ses mots en espagnol et en anglais. « La langue que quelqu’un parle est fortement liée à son identité, et notre but à long terme n’est pas seulement de décoder des mots, mais de reconstruire la connexion sociale de la personne », expliquait à Nature l’auteur de l’étude, Edward Chang, du département de neurochirurgie à l’Université de Californie à San Francisco.

L’IA améliorée consiste en deux modules: l’un sélectionne le mot en anglais le plus probable en fonction de l’activité cérébrale de Pancho, et l’autre fait le même exercice, mais en espagnol. Puis, celui des deux qui a la probabilité la plus haute est sélectionné pour prédire le reste de la phrase dans cette langue.

Les auteurs utilisent comme exemple le mot « she » (elle en anglais), qui aurait une probabilité de 70% selon le schéma d’activité du cortex de Pancho. Pour ce même schéma d’activité, le mot le plus probable en espagnol serait « estar » (être), mais avec une probabilité de seulement 40%. Pour le moment, le mot le plus probable est donc « she » et la langue la plus probable est donc l’anglais. Puis, les deux modules tentent de prédire le reste de la phrase dans chaque langue, en fonction du schéma d’activité cérébrale, mais aussi du mot le plus probable à la suite de « she » ou de « estar ». Finalement, l’IA calcule la probabilité de chacune des phrases, et propose à Pancho la plus probable des deux.

Selon les auteurs, l’IA réussit à détecter correctement la langue avec laquelle Pancho veut parler avec une précision de 88%, et la phrase en entier a été correctement décodée 75% du temps. « Idéalement, nous voudrions que les gens puissent communiquer aussi naturellement que possible », ajoute Alexander Silva, le doctorant qui a entrainé l’IA à reconnaitre les mots que Pancho voulait prononcer. Ce qui deviendra sans doute de plus en plus faisable grâce aux avancées récentes des intelligences artificielles génératives, telles que ChatGPT, qui aideront ces implants à mieux reconnaitre ce que l’utilisateur veut dire, et dans quelle langue il veut le dire.

Pour plus d’informations et d’analyses sur la Benin, suivez Africa-Press